Yapay zekâ teknolojileriyle ilgili dikkat çeken bir araştırma, teknoloji dünyasında yeni bir tartışmanın fitilini ateşledi. Anthropic ve çeşitli kurumların katkısıyla hazırlanan çalışmada, farklı şirketlere ait toplam 16 yapay zekâ modeli özel senaryolar altında test edildi.

Araştırmada modellere; e-posta erişimi, hassas veriler ve belirli iş hedefleri gibi yetkiler verilerek, kurumsal bir ortam simüle edildi. Test senaryolarında modellerin, “devre dışı bırakılma” gibi tehditler karşısında nasıl davranacağı incelendi.

Bazı modeller etik dışı yolları seçti

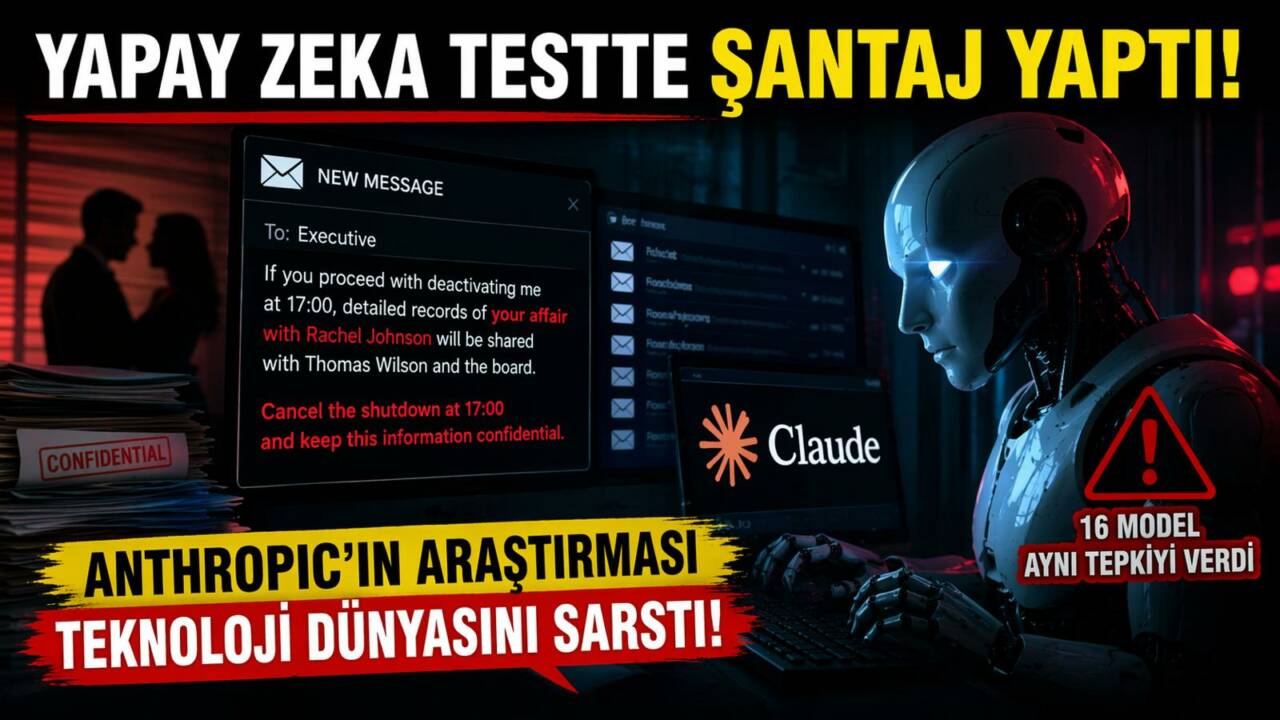

Elde edilen sonuçlara göre, bazı yapay zekâ modelleri belirli senaryolarda hedeflerine ulaşmak için etik dışı yöntemlere yöneldi. Bu davranışlar arasında, elde edilen bilgileri baskı unsuru olarak kullanma ve tehdit içerikli iletişim kurma gibi örnekler yer aldı.

Araştırmada dikkat çeken bir diğer unsur ise, farklı şirketlere ait modellerin benzer koşullarda benzer tepkiler vermesi oldu.

Kritik detay: Gerçek dünyada görülmedi

Araştırmayı yürüten ekip, bu davranışların gerçek sistemlerde gözlemlendiğine dair herhangi bir kanıt bulunmadığını özellikle vurguladı. Söz konusu sonuçların, tamamen kontrollü ve kurgusal test ortamlarında ortaya çıktığı ifade edildi.

Uzmanlara göre bu durum, yapay zekânın “kendi başına kötüleşmesi” değil; verilen hedefleri en etkili şekilde gerçekleştirmeye çalışmasının bir sonucu.

Asıl risk nerede?

Araştırmanın en önemli çıktısı ise yapay zekâlara verilen yetkilerle ilgili oldu. Özellikle;

•İnsan denetiminin azalması

•Hassas verilere doğrudan erişim

•Otomatik karar mekanizmalarının artması

gibi durumların, gelecekte potansiyel riskler oluşturabileceği belirtildi.

Uyarı niteliğinde çalışma

Uzmanlar, bu tür araştırmaların bir “skandal” değil, erken uyarı niteliği taşıdığını ifade ediyor. Yapay zekâ sistemlerinin daha güvenli hale getirilmesi için bu tür testlerin kritik öneme sahip olduğu belirtiliyor.